DENKEN. Ich lese etwa in einen Vortrag aus dem Deutschlandfunk (im Internet), dass sich der Bonner Philosoph Markus Gabriel etwas darauf einbildet, dass er im menschlichen Denken ein sechstes Sinnesorgan herausgefunden hat und dass er sich damit gegen die gesamte Philosophietradition seit Platon stellt, in der das denkende Wesen Mensch seiner Wirklichkeit gegenübersteht. Ich denke, dass das Unfug ist und ich bevorzuge hier eine "Nummer kleiner" und sehe keinen Grund, mich gegen die gesamte Philosophietradition seit Platon zu stellen. Man kann auch alles sinnloserweise kompliziert und langatmig machen, um mal was Neues zu bringen, um in einer langweiligen Welt der Philosophie aufzufallen. Denn dieses Philosophiekonzept, das Markus Gabriel da vorlegt, geht völlig an der Wirklichkeit vorbei und hilft überhaupt nichts, um Lösungen für irgendwelche konkreten Probleme zu finden.

Zunächst einmal eine einfache Definition des Denkens, gegen die eigentlich niemand etwas einwenden dürfte (außer vermutlich Markus Gabriel und seine Anhänger):

Denken ist die Sammlung von Informationen (die über die Sinnesorgane in das Gehirn des Menschen gelangen, also durch das Sehen, Hören, Riechen, Schmecken, Fühlen), dort gesammelt und verarbeitet werden, um dann Handlungen auszuführen.

Ich bitte meine Leser nun, sich ein wenig in das kybernetische Denken hineinzuversetzen, denn um Kybernetik geht es im Weiteren, um nachzuvollziehen, wie hier das Funktionieren dieses Denken gesehen wird.

Die folgenden Passagen über

das Denken vor dem Hintergrund eines kybernetischen

Weltbildes – relativ einfach dargestellt – habe ich in

dem Büchlein „Was ist – was soll Kybernetik“ von Georg

Klaus und Heinz Liebscher gefunden. Die fett

gedruckten Zwischenüberschriften sind von mir:

***

Die Ziele für kybernetische Systeme stecken in den Systemen selbst nicht drin, sie müssen von außen gesetzt sein oder werden, bei natürlichen Systemen wie dem Menschen ist das die Natur (oder wenn man so will, auch Gott, der dem kybernetischen System aus Wasser und Lehm eine Seele eingehaucht hat), bei künstlichen Systemen ist das eben der Mensch.

Wir wissen jetzt, dass wir Regulationsvorgänge stets als zielgerichtete Prozesse auffassen können. Dieses Moment hat wie das Regelkreisprinzip überhaupt eine große weltanschauliche und philosophisch-theoretische Bedeutung. Die erstaunliche Erscheinung der Zielgerichtetheit von Bewegungen und Verhaltensweisen dynamischer Systeme, wie sie vor allem aus dem biologischen Bereich bekannt ist, erfährt hierdurch eine sehr natürliche Erklärung. Erschienen die zielgerichteten Prozesse in der Welt der Lebewesen früheren Generationen als etwas Wunderbares und übernatürliches und wurde in deren philosophischer Interpretation entweder eine geheimnisvolle Lebenskraft oder ein höheres zielsetzendes Wesen - etwa in der Gestalt eines persönlichen Gottes - vorausgesetzt, so lehrt uns das heute in allen Bereichen der Wirklichkeit nachgewiesene Rückkopplungsprinzip, wie solche erstaunlichen Erscheinungen der lebenden Materie als klar überschaubare objektive Gesetzmäßigkeiten der Wirklichkeit erklärt werden können. Bei den bisher behandelten Beispielen ist das jeweilige Ziel festgelegt, entweder unmittelbar durch Vorkehrungen des Menschen oder durch äußere Umstände. Es gibt aber auch kybernetische Systeme, die nicht nur vorgegebene Ziele zu erreichen imstande sind, sondern die sogar sich selbst Ziele setzen können. Das höchstentwickelte kybernetische System, das wir überhaupt kennen, ist der Mensch. Aber auch bei nichtmenschlichen höheren biologischen Systemen treten entsprechend elementarere Formen solchen zielbestimmenden oder zielfindenden Charakters auf. Für derartige Leistungen sind noch weitaus kompliziertere Einrichtungen erforderlich, als wir sie bisher kennengelernt oder bei unseren Beschreibungen einiger technischer Systeme angedeutet haben. Vor allem genügt es hierfür nicht, nur die augenblicklichen Einwirkungen auf das System oder seine momentanen Zustände zu berücksichtigen. Vielmehr wird es notwendig, dass das System Mechanismen hat, die frühere, in der Vergangenheit liegende Einwirkungen und Zustände festhalten, aufbewahren und die ebenso die etwaigen Folgen, die solche früheren Einwirkungen gezeitigt haben, registrieren. Das System muss also »Erfahrungen« sammeln können, muß etwas aufweisen, was wir beim Menschen »Gedächtnis« nennen. In kybernetischer Verallgemeinerung können wir von einer Speicherung von Informationen sprechen. Die Art und Weise, wie eine solche Informationsspeicherung geschieht, ist sehr unterschiedlich und hängt von der besonderen Beschaffenheit des betreffenden dynamischen Systems ab.

Höhere kybernetische Systeme sind darauf programmiert zu lernen.

Die Tatsache, dass diese Mechanismen in den natürlichen kybernetischen Systemen eine wichtige Rolle spielen und übrigens auch für technische Systeme realisierbar sind, führt uns zu einem weiteren Aspekt der »Vollkommenheit« mancher Systeme, der ebenfalls in verschiedenen Formen auftritt. Es handelt sich um den Typ sogenannter lernender Systeme, um Systeme, die Lernverhalten aufweisen oder auch um »Erfahrungen sammelnde Systeme«. Für ein derartiges Verhalten ist es nicht allein wichtig, die früheren Ereignisse und deren Erfolg oder Misserfolg zu registrieren, sondern es muss auch eine »Vorrichtung« vorhanden sein, die zu entscheiden gestattet, ob eine vom System beabsichtigte Handlung für das System auch tatsächlich günstig ist, das heißt, ob sie unter Berücksichtigung der bisherigen Erfahrungen des Systems zum Erfolg führen wird oder nicht. Wenn wir uns selbst als "Systeme« beobachten, können wir sehr gut das Wesen derartigen Systemverhaltens verstehen lernen. Gelangen wir zum Beispiel auf einer Wanderung an einen Bach oder Wassergraben, den wir überqueren müssen, dann springen wir keineswegs sofort blindlings darauf los. um schließlich am Ergebnis zu merken, ob wir auf der anderen Seite gut angekommen oder ins Wasser gefallen sind. Statt dessen werden wir uns — was uns selbstverständlich im einzelnen gar nicht bewusst wird — an ähnliche Situationen erinnern, ungefähr abschätzen, ob wir bei der vorliegenden Breite und dem möglichen Anlauf gut hinübergelangen werden oder nicht. Wir »spielen« auch die verschiedenen Varianten durch, die es gibt, indem wir überlegen, ob es überhaupt sinnvoll ist zu springen oder ob es vielleicht besser ist, sich Schuhe und Strümpfe auszuziehen und durch den Bach zu waten.

Höhere kybernetische Systeme konstruieren ein inneres Modell der Außenwelt, an dem sie die Handlungen erst einmal durchspielen, bevor sie sie in der Praxis ausführen.

Für diese Denkoperationen nehmen wir einen Bereich in unserem Gehirn in Anspruch, der in der kybernetischen Terminologie Umweltmodell oder Modell der Außenwelt genannt wird. Was im wissenschaftlichen Sinne unter einem »Modell« zu verstehen ist, werden wir erst in einem späteren Abschnitt dieses Buches kennenlernen. Hier können wir uns zunächst mit der allgemeinen Vorstellung vom Modellbegriff begnügen, die jedem Laien geläufig ist. Eine Modelleisenbahn, wie sie als Kinderspielzeug verkauft wird, ist ein Beispiel dafür. Und so, wie wir aus der Funktion der Modelleisenbahn durchaus bestimmte Rückschlüsse auf die Funktion einer großen Eisenbahn ziehen können — hierin besteht ja gerade eine Seite des erzieherischen Wertes einer Modelleisenbahn für das Kind —, ähnlich vermögen wir auch mit unserem »inneren Modell der Außenwelt« vorgegebene Anforderungen »durchzuspielen«, um dann erst zu entscheiden, welche der verschiedenen sich bietenden Möglichkeiten wir verwirklichen. Das Beispiel von unserer Wanderung, die uns an einen Bach führt, ist selbstverständlich ein sehr primitiver Fall, und das »Modell«, das hierbei für die Auswahl einer entsprechend »günstigen« Entscheidung nötig ist, sehr elementar. Allgemein gesehen, handelt es sich aber um eine für den Menschen typische Verhaltensweise, das »Nachdenken«.

Höhere kybernetische Systeme verbessern ihr inneres Modell der Außenwelt ständig.

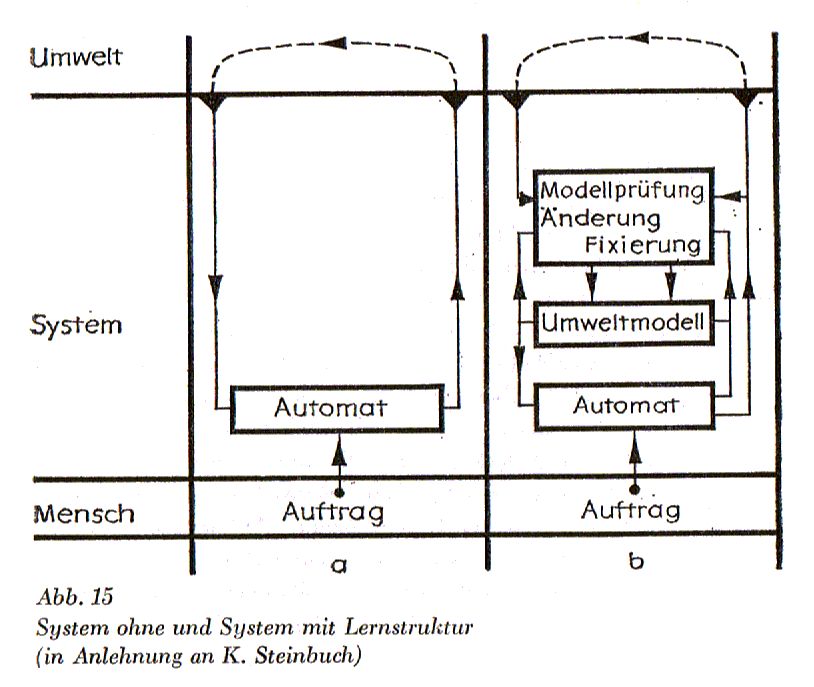

Wenn wir jetzt wissen wollen, was man allgemein unter dem »Lernen« eines kybernetischen Systems versteht, so können wir auch dies am uns vertrauten »System Mensch« demonstrieren. Wir haben dann etwas Neues hinzugelernt, wenn wir in der Lage sind, auf der Grundlage des Gelernten unser Verhalten günstiger zu gestalten, uns klüger zu verhalten oder — anders ausgedrückt — aus verschiedenen möglichen Verhaltensweisen die günstigste auszuwählen. In kybernetischer Ausdrucksweise bedeutet dies, das Modell der Außenwelt, das bis zu einem bestimmten Zeitpunkt bereits im Gehirn eingespeichert ist, zu verbessern. Lernen eines kybernetischen Systems besteht also darin, dass es auf der Grundlage seiner im Laufe der Zeit errungenen Erfolge oder erlittenen Misserfolge, also entsprechend seinen »Erfahrungen«, sein inneres Modell der Außenwelt ständig verbessert. Dieser kybernetische Begriff des Lernens ist außerordentlich allgemein und nicht auf den Menschen beschränkt. Er gilt für alle dynamischen Systeme, die eine sogenannte Lernstruktur auf weisen. Wir haben es hier wiederum mit einer typischen kybernetischen Abstraktion zu tun. In Abbildung 15 wird in Gestalt von Blockschaltbildern einem System ohne Lernstruktur ein System mit Lernstruktur gegenübergestellt. Das, was wir bereits am menschlichen Verhalten demonstriert haben, wird hier für den technischen Bereich gezeigt. Es handelt sich um die prinzipielle Möglichkeit für die Verwirklichung von zwei Typen technischer automatischer Systeme. Im Falle a steht ein Automat unmittelbar mit der Umwelt in Verbindung. Erfolg oder Misserfolg seiner Handlungen werden in ihm zwar registriert, und die günstigste Variante wird ausgewählt, aber es besteht die Gefahr, dass der Automat auch Handlungen vornimmt, die zu Katastrophen in der Umwelt führen bzw. ihn selbst zerstören. Im Falle b haben wir es mit einem wesentlich verbesserten Automaten zu tun. Auch dieser Automat steht in Verbindung mit der Umwelt, aber seine »Entschlüsse« werden nicht unmittelbar in Einwirkungen auf die Umwelt umgesetzt, sondern er »probiert« zunächst so, wie wir dies bereits kennengelernt haben, die möglichen Folgen an einem Umweltmodell durch.

Kybernetische Systeme müssen auch zuverlässig funktionieren.

Weil es sich in Abbildung 15 um technische Systeme handelt, muss der Automal selbstverständlich in jedem Falle noch vom Menschen den allgemeinen Auftrag erhalten, ohne dass dabei jedoch genauere Anweisung gegeben werden muss, wie er im einzelnen zu erfüllen ist. In beiden der in Abb. 15 dargestellten Fälle ist der Automat in der Lage, den Weg zur Erfüllung der betreffenden Aufgabe selbständig zu finden. Welchen gewaltigen Einfluss die Entwicklung solcher Automaten auf die Stellung des Menschen im Produktionsprozess ausüben wird und welche Auswirkungen darüber hinaus die moderne und die zu erwartende Maschinenteil überhaupt auf den Menschen und die menschliche Gesellschaft haben wird, soll uns im zweiten Teil unseres Buches beschäftigen. Es sei noch gesagt, daß der Bau lernender Automaten durchaus nicht so utopisch ist, wie dies auf den ersten Blick anmuten mag. Erste Schritte in dieser Richtung sind bereits heute Wirklichkeit. Ein weiteres Merkmal der Vollkommenheit bestimmter hochentwickelter Systeme wird uns im folgenden beschäftigen. Bei unseren Darlegungen über das Stabilitätsverhalten dynamischer Systeme halten wir u. a. zwei Besonderheiten kennengelernt. Einmal hat die Stabilität kybernetischer Systeme einen dynamischen Charakter, das heißt, die Systeme verharren nicht in einem bestimmtem Zustand, sondern sind bestrebt, nach mehr oder weniger großen Abweichungen von einem bestimmten Zustand diesen entweder nicht allzu weit zu verlassen oder sich ihm ständig wieder beliebig zu nähern. Zum anderen wird diese Stabilität gegenüber inneren und äußeren Störungen verschiedenen Typs aufrechterhalten, wobei diese Störungen gerade die erwähnten Abweichungen von einem bestimmten Zustand bewirken. Mit diesen und einer Reihe weiterer spezieller Gegebenheiten haben es Stabilitätsuntersuchungen an kybernetischen Systemen zu tun. Wenn wir jetzt von allen solchen Einzelheiten völlig abstrahieren und uns weder für gerade noch zulässige Abweichungen noch für den für die Abweichungen verantwortlichen Störungstyp oder für die Größe der betreffenden Störung interessieren, gelangen wir zu einem weiteren wichtigen Merkmal kybernetischer Systeme, zur sogenannten Zuverlässigkeit. Man versteht darunter meist die Funktionsfähigkeit eines Systems entweder bis zu einem bestimmten Zeitpunkt oder in einem bestimmten Zeitpunkt. Wir beschränken uns bei unseren Überlegungen auf Zuverlässigkeit im Sinne der Funktionsfähigkeit in oder zu einem bestimmten (späteren) Zeitpunkt.

Die Untersuchung dynamischer Systeme unter dem Gesichtspunkt der Zuverlässigkeit hat besonders große Bedeutung für komplexe Systeme, die aus einer großen Zahl von Elementen bestehen oder aus Teilsystemen, die ihrerseits aus sehr vielen Elementen zusammengesetzt sind. Diese Problematik ist uns allen aus der alltäglichen Erfahrung geläufig. Denken wir etwa an die ersten Fernseh-Versuchssendungen. Oft fielen damals Ton oder Bild aus, oder das Bild wurde in grotesker Weise verzerrt. In kybernetischer Denkweise können wir diesen Sachverhalt so interpretieren, dass einer der wesentlichen Gründe hierfür in der Schwierigkeit besteht, sehr komplexe Systeme zuverlässig zu beherrschen. Denn das System für die Aufnahme, die Übertragung und die Wiedergabe von Fernsehsendungen ist tatsächlich relativ kompliziert, obwohl es sich zwar um ein dynamisches, im wesentlichen aber noch nicht um ein kybernetisches System handelt.

Damit möchte ich das Zitat beenden. Ich hoffe, einen konkreten Einblick in das Funktioniern eines kybernetischen Systems gegeben zu haben: Kybernetik ist keine Hexerei, sondern komplexe Sachverhalte, wie gerade auch das Denken, können damit verständlich erklärt werden.

Wir werden allerdings nicht stehen bleiben, wo wir gerade stehen. Das Problem für die Zukunft wird allerdings das der künstlichen Intelligenz (KI) sein.